خروجی ها

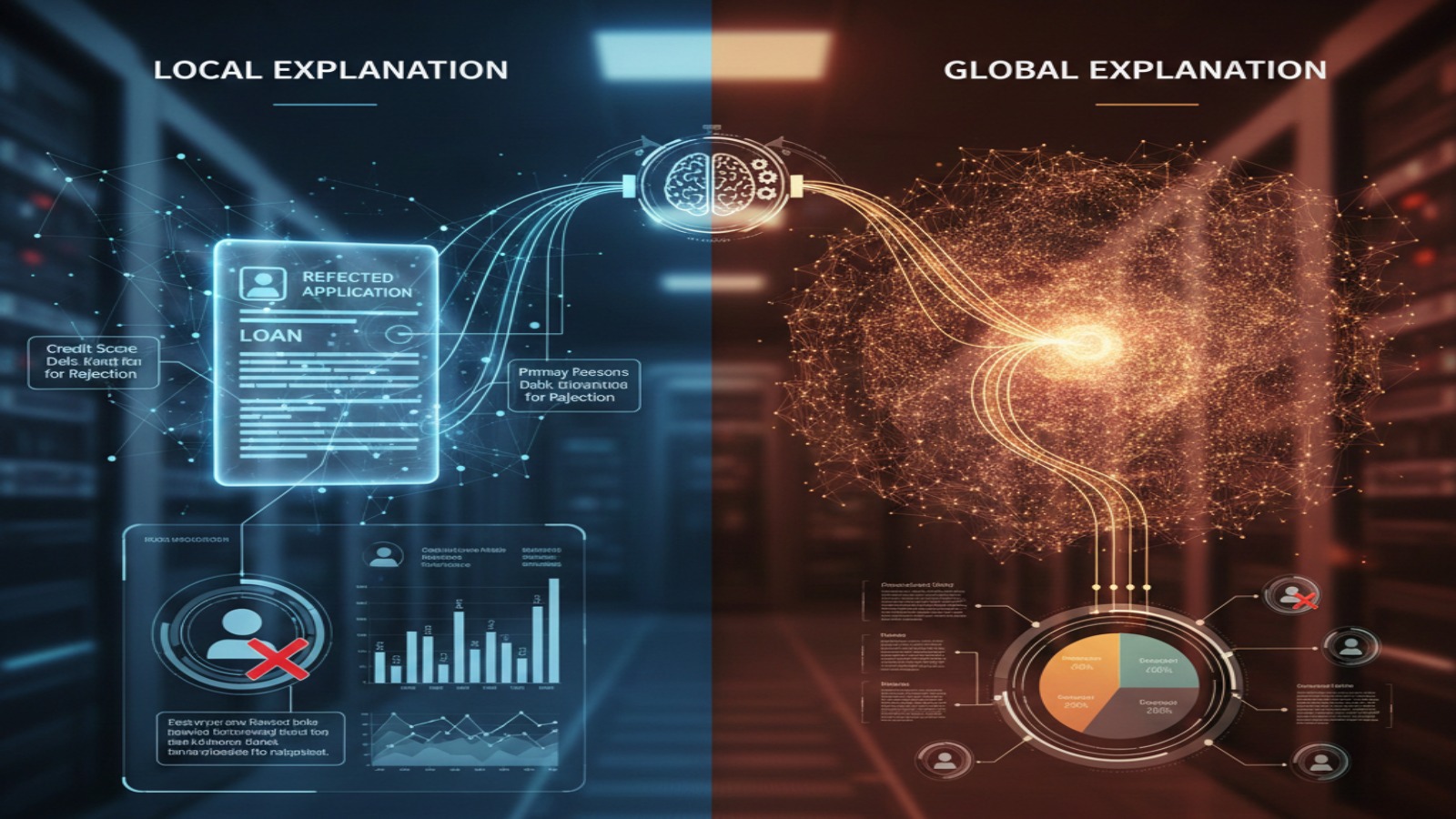

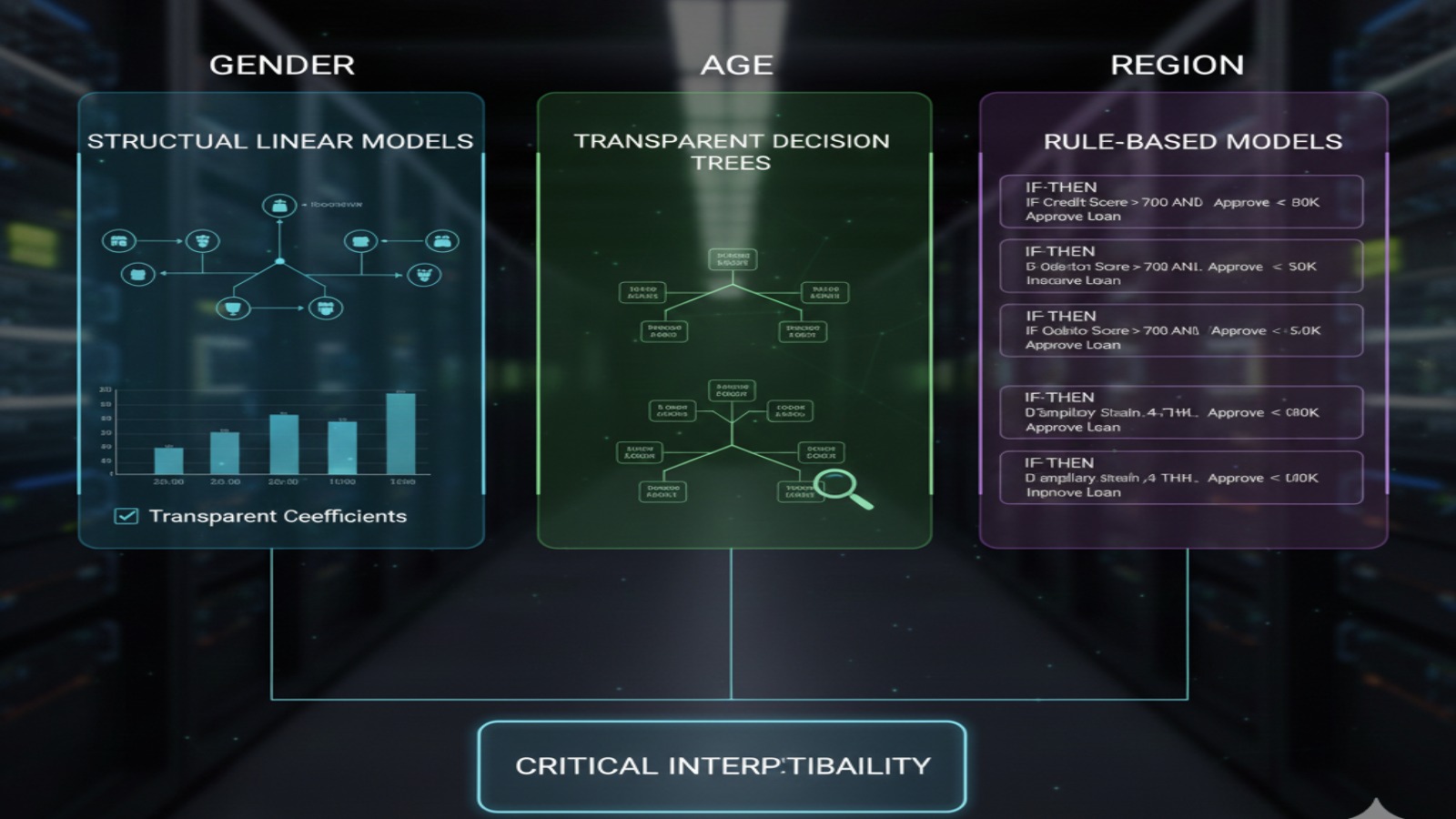

گزارشهای تفسیرپذیری محلی و کلی (با نمودارها و توضیحات متنی).

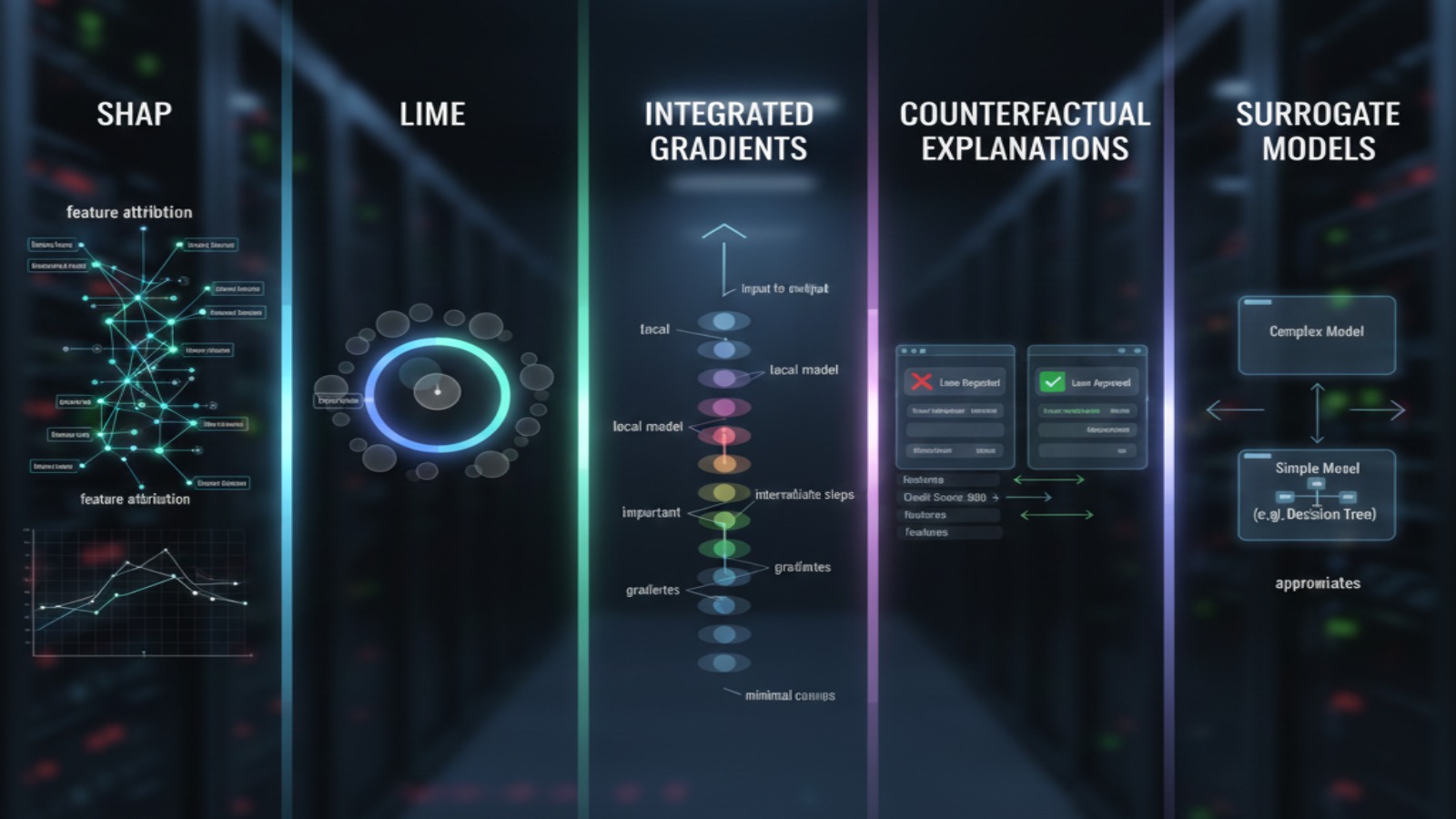

مجموعه اسکریپتها و نوتبوکهای تحلیل (SHAP/LIME/IG).

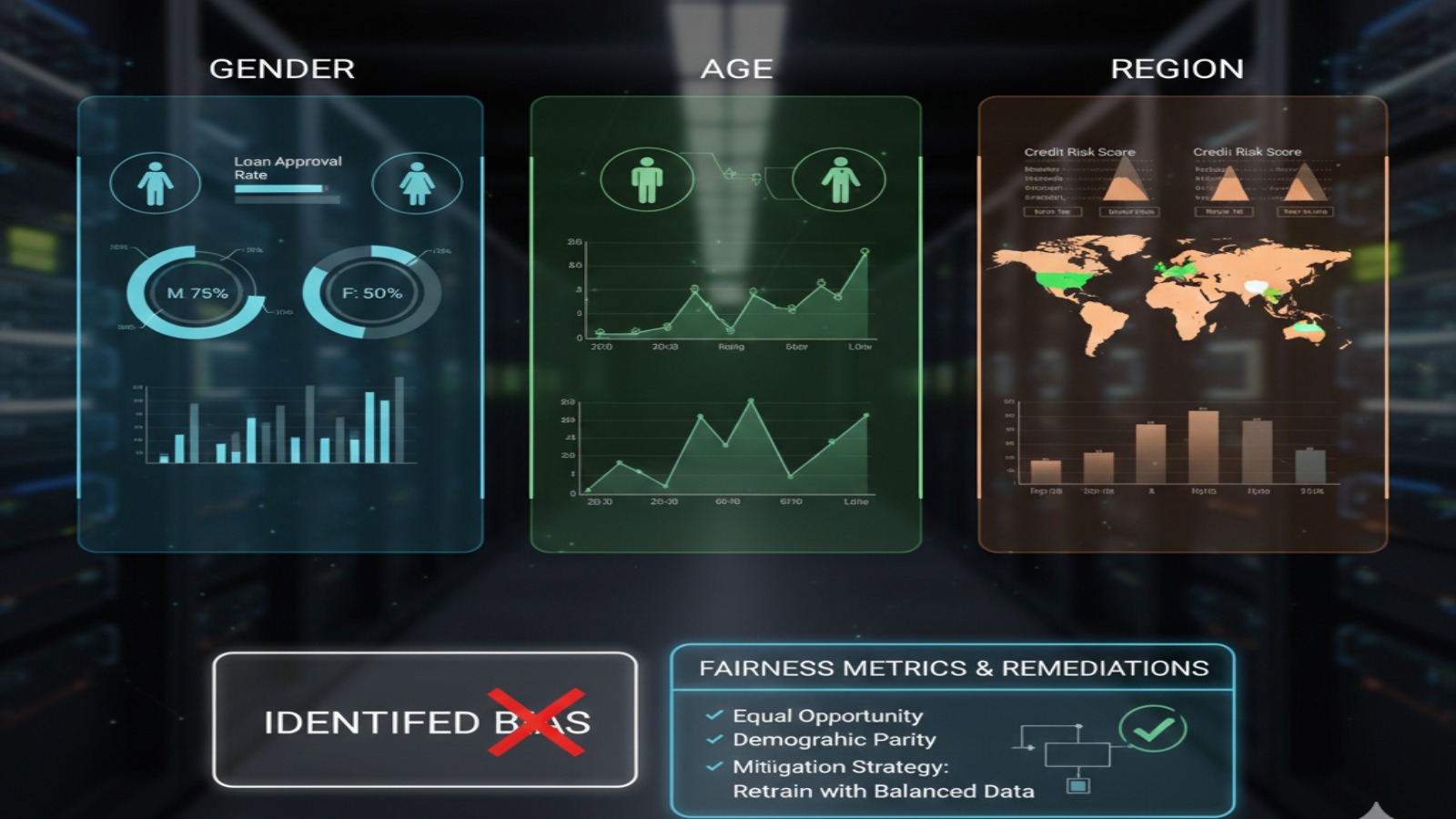

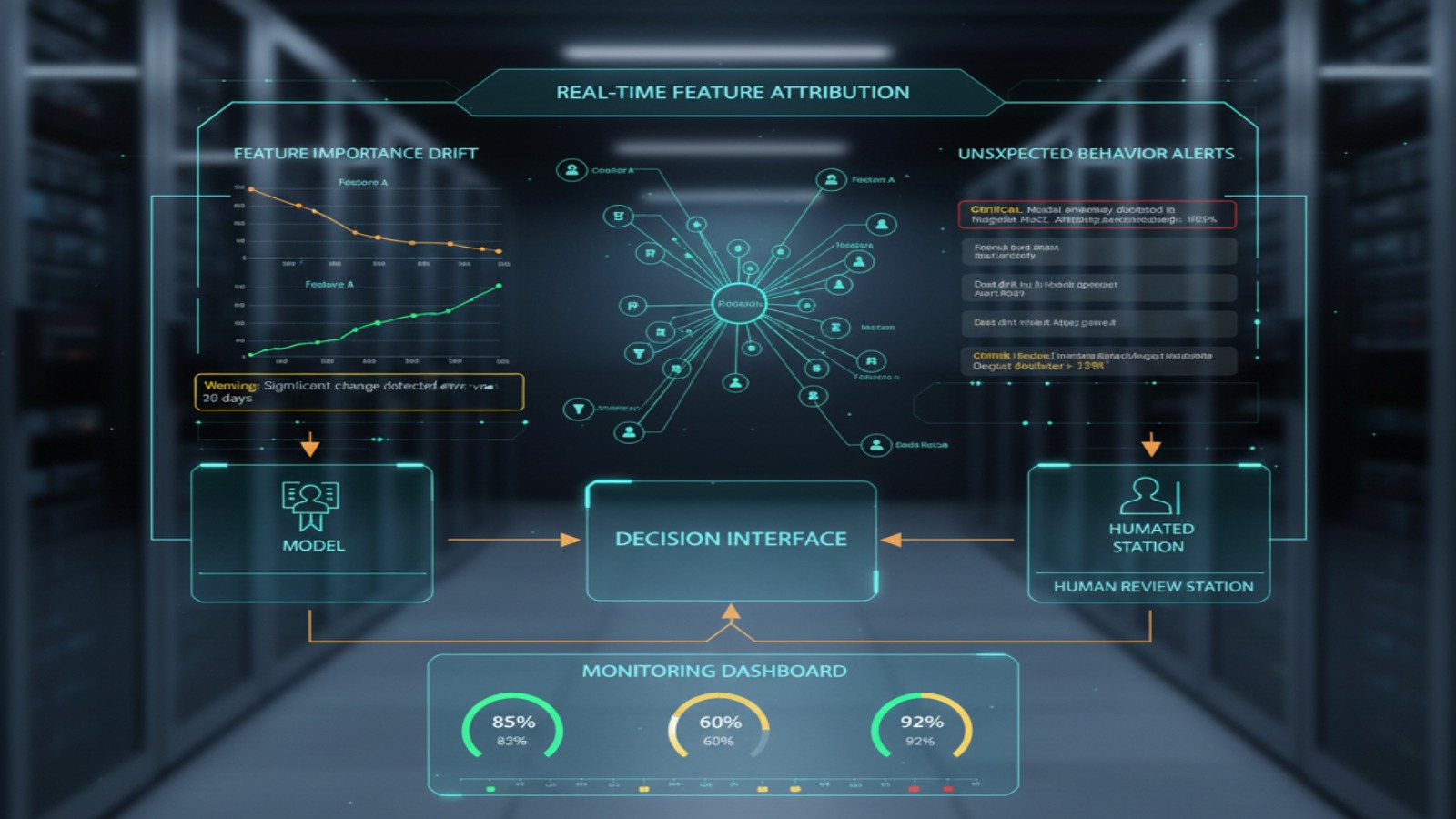

داشبورد مانیتورینگ تفسیر و معیارهای انصاف.

توصیههای اصلاح مدل و طرح عملیاتی برای کاهش سوگیری.

مستندات فنی و نسخهای از pipeline برای تکرارپذیری تحلیل.